El riesgo de la velocidad: Cómo el GitHub MCP Server evita desastres con secretos en la IA

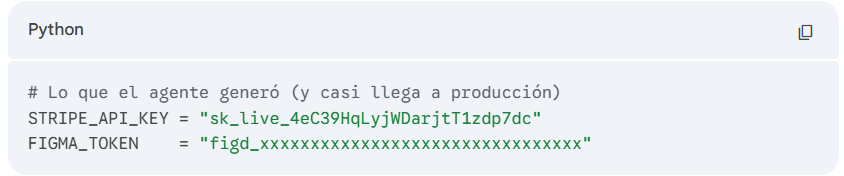

Hace unos meses, mientras trabajaba tarde en una integración de pagos desde VS Code, viví uno de esos momentos que todo desarrollador teme. El agente de IA generó el código, funcionó perfecto en local y, confiado en el resultado, hice el commit casi por inercia.

Al día siguiente, revisando el PR con más calma, encontré una línea que me heló la sangre: una API key real, live y hardcodeada. El agente la había incluido para que el ejemplo fuera funcional y yo, totalmente enfocado en la lógica del flujo, la pasé por alto.

No se trató de un descuido por falta de experiencia, sino de un desafío de la era actual: cuando una IA genera 200 líneas de código en segundos, el ojo humano tiende a validar que la lógica funcione, perdiendo de vista detalles críticos como una llave de Stripe en la línea 47.

La llegada de Secret Scanning al flujo de la IA

A finales de marzo, GitHub lanzó en Public Preview una funcionalidad que soluciona este problema de raíz: Secret Scanning directamente en el agente de IA vía el GitHub MCP Server.

Esta integración permite que el motor de seguridad de GitHub actúe como un revisor en tiempo real dentro del chat. Ahora, antes de confirmar cualquier cambio, es posible realizar una auditoría de seguridad sin salir del IDE y sin esperar a que el pipeline de CI/CD detecte el error (o peor aún, que no lo detecte).

¿Cómo funciona el prompt?

La ventaja competitiva de esta herramienta es su simplicidad. Basta con interactuar con el agente usando un comando específico:

"Scan my current changes for exposed secrets and show me the files and lines I should update before I commit."

Al recibir esta instrucción, el agente consulta el motor oficial de GitHub Secret Scanning y señala con precisión el archivo y la línea que deben corregirse. Además, esta semana se anunció la expansión del Push Protection, que ahora bloquea por defecto credenciales de servicios esenciales para el desarrollo de IA, como Figma, GCP y LangChain.

Guía rápida: Cómo activar GitHub Secret Scanning en tu flujo de IA

Para habilitar esta capa de protección en un entorno de desarrollo, se requieren tres pilares configurados:

- GitHub MCP Server configurado correctamente en tu entorno de desarrollo.

- Agente de Advanced Security instalado y habilitado en tu Copilot Chat.

- GitHub Secret Protection activado a nivel de repositorio.

Dato clave de costos: Muchos creen que estas funciones son exclusivas de licencias Enterprise. Sin embargo, desde el año pasado, Secret Protection está disponible para planes GitHub Team por solo $19 USD al mes por committer. Esto reduce la barrera económica y convierte la seguridad proactiva en un estándar alcanzable para equipos de cualquier tamaño.

Seguridad proactiva en la era de la IA

La IA nos da una velocidad sin precedentes, pero eso mismo nos exige mecanismos de control más inteligentes. En mi experiencia, he podido acompañar a diversos clientes en la implementación técnica de GitHub Advanced Security, y el mayor aprendizaje ha sido cómo lograr que el equipo la integre de forma natural en su flujo diario.

Si estás evaluando cómo fortalecer tu stack tecnológico o cómo asegurar que la adopción de agentes de IA no comprometa la integridad de tus credenciales, lo ideal es comenzar por estos controles preventivos. La tecnología ya está disponible, y ahora el siguiente paso es integrarla donde realmente ocurre el desarrollo. Sí, la IA es increíblemente rápida, pero necesita guardianes igual de veloces.

.png)